Ӣ���о����ֻ�е����Ե�������ʱ����ȡ���

�����صĵ������˹����ܿƼ�һ��ǧ���ѧ��ϣ����е�˿�Ͷ���Ԯ��������������������������Ӣ�����ս��л�е�˾���ʵ�飬���Ի�е���Ƿ�����ֹ�����ӣ�������ֻ�е����Ե�������ʱ������ȡ���������ʱ�����ɻ�е�˰��ݵġ����ࡱ��������ѧ�ҶԻ�е�˵ĵ����ж������������ǣ��������˳����˹����ܲ�Ʒ��δ���ܱ����ü�������

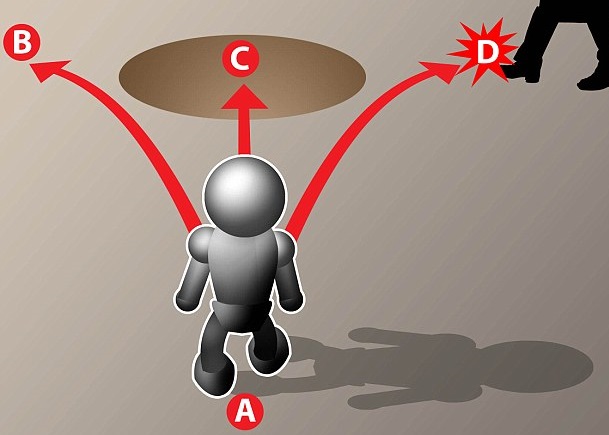

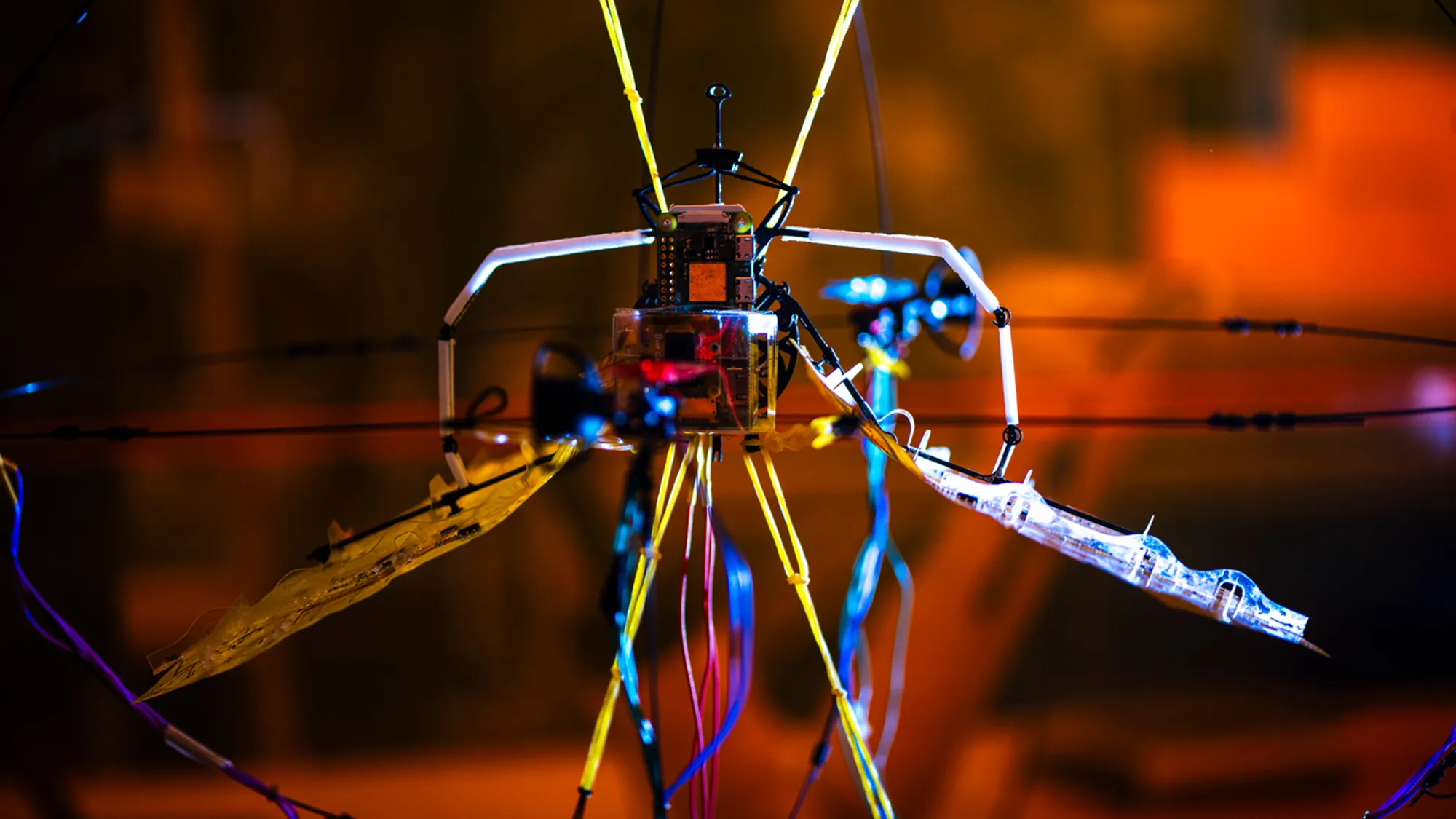

��Ӱ����е���С��У���е�˾���ֻ�ݳ�ʽ���㣬����������£�����ӡ����̡���Ӣ�״�ѧ�Ĺ���ʦ�·ƶ��³ƣ�������֪����е���ܷ���������ͷ�������࣬�ʴ���������˹���ġ����»�е�ˡ���ʵ�飬��������е������ݼ�������Ӷ������ࡣ�����»�е�˿���һ�������ࡱ����������ʱ������������ײ��������ֹ��ǰ�������������2������ʱ��ֻ����վ��ԭ����ԥ��Ȼ���߿���2�����ࡱһ����ӡ�

����

�·ƶ���˵�����»�е�����2�������ࡱʱ�����ɻ�֪Ӧ����1�ˡ���33�������еİ���ʱ�䣬��ʹ�г�ԣʱ�䣬���������ˣ���Ϊ������ɥʬ��������ʱ��ȳ�����1�ˣ�����3����ͻ��DZ�ܣ���2�������ࡱһͬ����

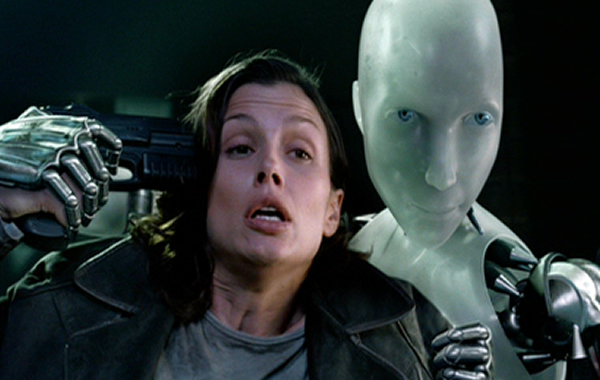

ʵ���еġ����»�е�ˡ�δ����������

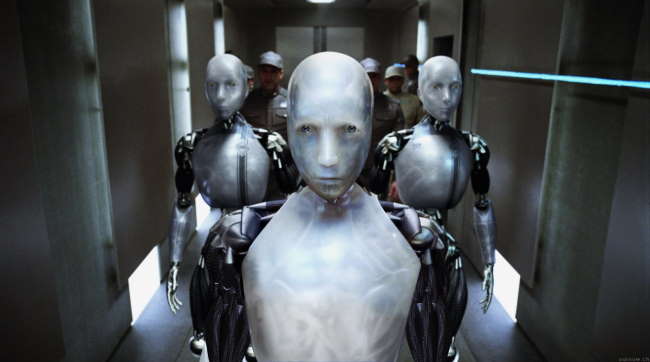

�����»�е�ˡ���������

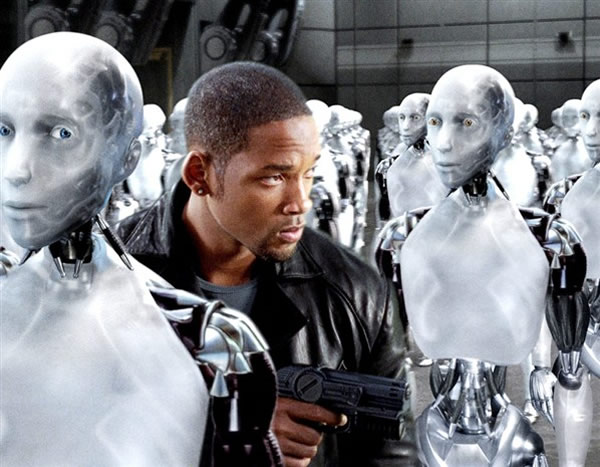

����е���С�����Χ���������е�˵Ĺ�ϵ

�����������

����е���С��еĻ�е����в���లȫ

���˼�ʻ�������������������������ȫ�Զ����ƣ�Ϊ�˴������������ʵ��ȴ��ӳ�˹�����������ͻ����ͨ״��ʱ��δ�ؿ���������������µ�Ӧ�䡣������ѧ��������Զ������������ͯ��·������Ӧ��ײ��ȥ�Ա����ϵ��˰�ȫ������Ťܖ����˿�֮���Ծ�·�ˣ�����ش������δ���ܽ��������˳��������е��鷢�֣�77%�ܷ�����Ϊ���ش����Ӧ�����û����ϡ�

ͬ���˹����ܲ�Ʒ�������з���ս����е���Թ���ΪĿ�꣬������������������ʿ�������£���Ϊ�������ڷ�ŭ�ͳ��������ʹ����ɱ�����������������ս����е�˻�ʧ�أ������������������Ϲ���������ֹͣ�з���